Triển khai Computer Vision (Thị giác máy tính) vào thực tế khó hơn nhiều so với việc chạy mô hình trong phòng Lab. Trên thực tế, 80% dự án AI thất bại ngay sau khi huấn luyện do những rào cản về hạ tầng và chi phí. Trong bài viết này, hãy cùng TOT tìm hiểu cách triển khai Computer Vision giúp rút ngắn thời gian đưa AI vào sản xuất từ vài tuần xuống còn vài phút, đảm bảo hiệu suất thời gian thực và khả năng mở rộng tối đa cho doanh nghiệp.

>> Xem thêm:

- Cách tạo ứng dụng bằng AI miễn phí, chi tiết, đơn giản 2026

- Cách sử dụng AI tối ưu trải nghiệm khách hàng: Xu hướng năm 2026

- AI nhận diện ảnh là gì? Thuật toán và ứng dụng phổ biến

Mở đầu

Triển khai hệ thống Computer Vision (Thị giác máy tính) vào vận hành thực tế không chỉ dừng lại ở việc xây dựng một mô hình thử nghiệm (Prototype).

- Thách thức thực tế: Một mô hình có thể hoạt động tốt trong môi trường kiểm soát, nhưng khi triển khai thực tế sẽ gặp phải các rào cản về hạ tầng (Infrastructure), độ trễ (Latency), tính ổn định và chi phí vận hành.

- Khoảng cách triển khai (Deployment Gap): Những trở ngại này tạo nên “khoảng cách triển khai”, giải thích lý do vì sao có đến 80% dự án Computer Vision thất bại ngay sau giai đoạn huấn luyện (Training phase) do thiếu sự chuẩn bị cho hệ thống vận hành thực tế (Production-ready).

- Giải pháp tối ưu: Để thu hẹp khoảng cách này, các nền tảng như Roboflow cung cấp giải pháp triển khai toàn diện (End-to-end), hỗ trợ đa dạng các dòng Model tiên tiến hiện nay như SAM 3, RF-DETR và YOLO.

Cách Triển Khai Computer Vision (Thị Giác Máy Tính)

Trong bài viết này, chúng ta sẽ cùng tìm hiểu các khái niệm cốt lõi để triển khai hệ thống Computer Vision với Roboflow, giúp đạt được hiệu suất ổn định trong môi trường vận hành thực tế.

1. Lựa chọn cấu trúc suy luận (Inference Architecture)

Đây là quá trình quyết định nơi hệ thống sẽ chạy các mô hình. Các hệ thống hiện đại thường sử dụng ba hướng tiếp cận: Cloud (Đám mây), Edge (Cạnh/Tại thiết bị), hoặc Hybrid (Mô hình hỗn hợp). Mỗi tùy chọn đều có những sự đánh đổi về độ trễ (Latency), chi phí, khả năng mở rộng (Scalability) và độ phức tạp trong vận hành thực tế.

Cloud Inference (Suy luận trên Đám mây)

Cloud Inference là việc chạy các mô hình Machine Learning hoặc Computer Vision trên các máy chủ từ xa được cung cấp bởi Roboflow, AWS, Google Cloud hoặc Azure thay vì xử lý dữ liệu tại địa phương.

Cơ chế hoạt động: Hệ thống gửi dữ liệu qua Internet đến các máy chủ hoặc Model API để tính toán và nhận kết quả trả về, giúp tận dụng tài nguyên phần cứng mạnh mẽ từ các trung tâm dữ liệu lớn.

Khi nào nên sử dụng Điện toán Đám mây?

- Các Mô hình Nền tảng: Nên dùng đám mây để truy cập vào các mô hình chuyên sâu về tính toán, đòi hỏi tài nguyên tính toán khổng lồ mà thiết bị cá nhân không thể vận hành hiệu quả. Các ví dụ điển hình bao gồm: SAM 3, Florence-2, các mô hình ngôn ngữ thị giác (VLM) và mô hình ngôn ngữ lớn (LLM).

- Khối lượng công việc biến động cao: Điện toán đám mây là lựa chọn lý tưởng để xử lý lượng dữ liệu quy mô lớn, thay đổi liên tục hoặc khó dự đoán trước.

- Thử nghiệm và tạo mẫu nhanh: Bạn có thể nhanh chóng kiểm tra các mô hình mới và cải tiến quy trình mà không cần phải đầu tư hay thiết lập phần cứng tại chỗ.

- Suy luận đa mô hình (Massive Ensemble Reasoning): Đám mây cho phép chạy song song nhiều mô hình cùng lúc để tối ưu hóa và nâng cao độ chính xác tổng thể.

- Khả năng khái quát hóa Zero-Shot / Few-Shot: Các mô hình trên đám mây được cung cấp qua API như GPT-5 hay Google Gemini 3 có khả năng nhận diện dữ liệu mới hoặc dữ liệu chưa từng thấy mà không cần phải trải qua quá trình huấn luyện lại.

Ưu điểm vượt trội: Cloud Inference cho phép mở rộng quy mô từ vài ảnh lên hàng triệu ảnh mà không cần bảo trì thiết bị, đồng thời dễ dàng tiếp cận các mô hình tiên tiến nhất như GPT-5, Gemini 3 hay Qwen3-235B.

Nhược điểm & Chi phí: Chi phí tăng dần theo quy mô, gặp thách thức về quyền riêng tư (GDPR, EU AI Act), độ trễ không ổn định cho các tác vụ thời gian thực và tốn kém chi phí truyền tải dữ liệu lớn.

Các phương thức triển khai Roboflow Cloud Inference:

- API không máy chủ: Vận hành các quy trình (Workflows) và suy luận mô hình trên hạ tầng đám mây được tăng tốc bởi GPU với khả năng tự động mở rộng. Các mô hình sau khi triển khai có thể dễ dàng truy cập thông qua REST API để thực hiện suy luận trên hình ảnh.

- API phát trực tuyến video: Xử lý video trực tiếp trên nền tảng đám mây của Roboflow bằng cách truyền phát (streaming) từ webcam, camera RTSP hoặc các tệp video qua giao thức WebRTC. Kết quả suy luận sẽ được trả về trực tiếp cho ứng dụng của bạn.

- Triển khai riêng biệt: Sử dụng các máy chủ đám mây riêng tư của Roboflow để chạy các mô hình thị giác máy tính, bao gồm: phát hiện đối tượng (object detection), phân đoạn (segmentation), phân loại (classification), phát hiện điểm mấu chốt (keypoint detection), CLIP và các quy trình Workflows ít mã nguồn (low-code).

- Xử lý hàng loạt: Chạy các quy trình Workflows một cách hiệu quả trên lượng lớn hình ảnh hoặc video đã lưu trữ. Đây là giải pháp lý tưởng để xử lý bất đồng bộ các khối lượng dữ liệu khổng lồ, tận dụng linh hoạt tài nguyên CPU hoặc GPU trên đám mây của Roboflow.

>> Xem thêm:

- Deep Learning là gì? Tổng quan về cách hoạt động và ứng dụng thực tế

- Hướng dẫn triển khai AI trong ứng dụng di động đơn giản, dễ hiểu

- Data Annotation Platforms: Nền tảng gán nhãn dữ liệu cho thị giác máy tính tốt nhất

Edge (On-Device) Inference (Suy luận tại thiết bị đầu cuối)

Edge Inference là quá trình chạy các mô hình Machine Learning hoặc Computer Vision trực tiếp trên thiết bị tại chỗ (nơi dữ liệu được tạo ra) như điện thoại thông minh, thiết bị IoT, hệ thống nhúng, camera công nghiệp hoặc máy tính chuyên dụng (NVIDIA Jetson, Raspberry Pi).

- Cơ chế: Thay vì gửi dữ liệu qua internet tới các máy chủ đám mây từ xa, việc xử lý được thực hiện ngay tại thiết bị, giúp tối ưu hóa tốc độ và bảo mật.

Khi nào nên sử dụng Edge Inference?

- Robot thời gian thực: Cần thiết khi máy móc phải phản ứng tức thì với môi trường xung quanh, nơi chỉ một chút độ trễ mạng cũng có thể dẫn đến hỏng hóc hoặc rủi ro an toàn.

- Tự động hóa công nghiệp: Triển khai mô hình trực tiếp trên phần cứng nhà máy để đảm bảo ra quyết định với độ trễ thấp và duy trì hoạt động liên tục ngay cả khi kết nối mạng không ổn định.

- Ứng dụng IoT từ xa (Nông nghiệp & Khai khoáng): Tại những khu vực có internet hạn chế, Edge Inference cho phép hệ thống vận hành tự lập mà không cần kết nối đám mây thường xuyên.

- Môi trường bảo mật cao: Giữ dữ liệu trên thiết bị khi thông tin không được phép rời khỏi cơ sở do các chính sách bảo mật, yêu cầu pháp lý hoặc tính nhạy cảm của hoạt động kinh doanh.

- Hạn chế về băng thông video: Chạy nhận diện cục bộ khi việc truyền tải luồng video độ phân giải cao (như 4K ở 30 FPS) lên đám mây quá tốn kém hoặc gây quá tải băng thông.

Ưu điểm và Thách thức:

- Lợi ích: Mang lại khả năng ra quyết định gần như tức thì (tốc độ dưới 10ms), hoạt động ngoại tuyến (offline) ổn định, tiết kiệm phí dịch vụ đám mây theo từng yêu cầu và xử lý tốt dữ liệu 4K tại chỗ.

- Chi phí & Quản lý: Đòi hỏi bảo trì phần cứng định kỳ, chi phí đầu tư thiết bị ban đầu cao và tăng độ phức tạp trong quản lý (giám sát tình trạng thiết bị, cập nhật phần mềm, đảm bảo hiệu suất mô hình đồng nhất).

Giải pháp triển khai: Bạn có thể vận hành mô hình và quy trình làm việc trên các thiết bị đầu cuối thông qua Roboflow Inference, một gói mã nguồn mở hỗ trợ quản lý luồng video, tiền xử lý và tối ưu hóa phần cứng để triển khai cục bộ hiệu quả.

Hybrid Inference – Suy luận hỗn hợp (Kết hợp Đám mây & Thiết bị)

Hybrid Inference là giải pháp “vẹn cả đôi đường”, kết hợp sức mạnh xử lý thời gian thực của thiết bị đầu cuối (Edge) với khả năng tính toán chuyên sâu của đám mây (Cloud).

Cơ chế vận hành: Các thiết bị Edge sẽ đưa ra quyết định tức thì bằng các mô hình nhẹ.

- Còn những trường hợp khó hoặc có độ tin cậy thấp sẽ được gửi lên Cloud để phân tích sâu hơn.

- Đám mây có thể dùng chính dữ liệu này để tái huấn luyện và cập nhật ngược lại cho thiết bị, tạo thành một vòng lặp học tập liên tục.

Roboflow hỗ trợ quy trình làm việc linh hoạt, cho phép chạy cùng một logic trên bất kỳ thiết bị hay nền tảng đám mây nào mà không cần chỉnh sửa mã nguồn.

Ưu điểm của mô hình Hybrid Inference:

- Độ trễ thấp cho các quyết định quan trọng: Đảm bảo phản hồi gần như tức thì nhờ xử lý các tác vụ thời gian thực ngay tại thiết bị.

- Tiết kiệm băng thông: Chỉ những dữ liệu phức tạp hoặc không chắc chắn mới được gửi lên Cloud, giúp giảm tải hệ thống và chi phí truyền tải.

- Học tập liên tục: Các thiết bị đầu cuối tự động gửi các trường hợp có độ tin cậy thấp (low-confidence) lên Cloud để huấn luyện lại, giúp mô hình luôn được cập nhật và thông minh hơn.

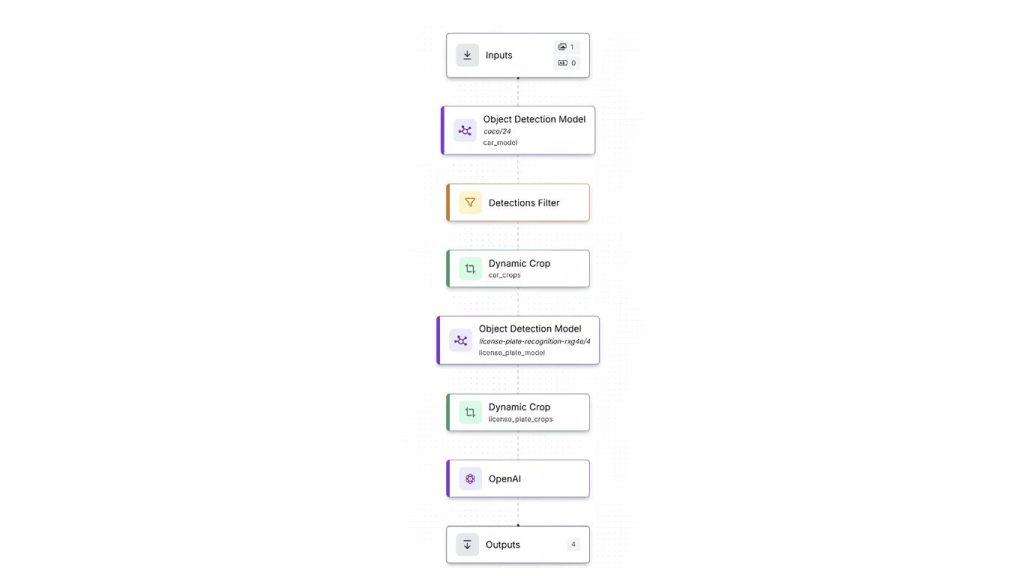

Ví dụ: Hệ thống Nhận diện Biển số xe (License Plate Recognition)

Quy trình làm việc bên dưới minh họa quy trình từ đầu đến cuối cho một hệ thống nhận diện biển số xe hiện đại:

- Tại thiết bị (Edge): Thực hiện nhận diện phương tiện và biển số, sau đó cắt (crop) riêng vùng ảnh chứa biển số.

- Trên Đám mây (Cloud): Nhận vùng ảnh đã cắt và sử dụng các mô hình ngôn ngữ thị giác tiên tiến (như OpenAI GPT-4 Vision) để trích xuất và phân tích văn bản biển số.

- Hiệu quả: Hệ thống này giúp tiết kiệm băng thông (chỉ gửi ảnh nhỏ đã cắt), giảm chi phí tính toán và duy trì chất lượng nhận diện cực cao nhờ xử lý ảnh gốc độ phân giải lớn ngay tại chỗ.

Kết luận: Thay vì phải đánh đổi giữa Cloud hay Edge, Hybrid Inference mang lại sự kết hợp hoàn hảo: Xử lý tại chỗ cực nhanh và phân tích trên đám mây cực sâu.

>> Xem thêm:

- Vertex AI là gì? Nền tảng học máy của Google Cloud

- Các công cụ thị giác máy tính không cần code hàng đầu năm 2026

2. Hệ thống phần cứng (The Hardware Stack)

Roboflow Inference được thiết kế tối ưu cho các môi trường thiết bị đầu cuối (Edge), hỗ trợ đa dạng các hệ thống phần cứng, giúp bạn cân bằng hoàn hảo giữa hiệu suất, chi phí và mức tiêu thụ điện năng tùy theo nhu cầu sử dụng.

Các dòng thiết bị hỗ trợ phổ biến:

NVIDIA Jetson Series: Đây là các mô-đun AI nhỏ gọn nhưng cực kỳ mạnh mẽ từ NVIDIA, kết hợp giữa GPU, CPU và các bộ tăng tốc chuyên dụng.

- Ứng dụng: Phù hợp cho robot thời gian thực, máy bay không người lái (drones) và camera thông minh.

=> Roboflow cung cấp các bộ cài đặt (Docker containers) được tối ưu hóa với TensorRT để đẩy hiệu suất xử lý lên mức tối đa.

Roboflow Flowbox: Một thiết bị dựa trên nền tảng Jetson, được thiết kế chuyên biệt cho môi trường sản xuất và logistics.

- Tính năng: Tích hợp sẵn Roboflow Inference, hỗ trợ các dòng camera công nghiệp (như Basler, Lucid), và dễ dàng kết nối với các hệ thống điều khiển nhà máy (PLC, HMI) thông qua giao thức OPC hoặc MQTT.

Raspberry Pi: Dòng máy tính bảng đơn (SBC) chi phí thấp chạy chip ARM.

- Ứng dụng: Dù không mạnh mẽ bằng GPU, nhưng Raspberry Pi 4 vẫn hoạt động tốt với các mô hình AI siêu nhẹ (Lightweight models) trong các dự án bị giới hạn về không gian hoặc ngân sách.

Camera Luxonis OAK: Dòng camera tích hợp sẵn bộ xử lý thần kinh (Intel Myriad X VPU) ngay bên trong thân máy.

- Ưu điểm: Cho phép xử lý AI ngay trên camera mà không cần thêm máy tính đi kèm, cực kỳ lý tưởng cho các giải pháp triển khai nhỏ gọn và tiết kiệm điện năng.

>> Xem thêm:

- DNS over HTTPS là gì? Cách kích hoạt DoH

- PKI là gì? Tổng quan về Public Key Infrastructure

- MFA là gì? Giải pháp ngăn chặn rò rỉ dữ liệu cho doanh nghiệp số

3. Tối ưu hóa tốc độ xử lý

Một khi mô hình đã được đưa vào vận hành thực tế, hệ thống Computer Vision cần phải được tinh chỉnh để đạt được sự cân bằng hoàn hảo giữa tốc độ và hiệu suất. Để làm được điều này, bạn có thể áp dụng một số kỹ thuật chuyên sâu sau đây:

Tối ưu hóa dữ liệu đầu vào

Chiến lược cốt lõi: Một trong những phương pháp hiệu quả nhất để tăng tốc độ suy luận (Inference speed) chính là chỉ xử lý những dữ liệu thực sự cần thiết.

Ví dụ: Nếu camera của bạn ghi hình ở độ phân giải 4K (3840×2160), nhưng mô hình AI của bạn lại được huấn luyện trên kích thước ảnh 640×640.

- Hệ quả: Khi đó, hệ thống sẽ phải tiêu tốn thêm một lượng tài nguyên tính toán đáng kể chỉ để thay đổi kích thước (Resize) các khung hình trong quá trình xử lý. Hơn nữa, mỗi điểm ảnh (Pixel) dư thừa đều làm tăng số lượng phép toán mà mô hình phải thực hiện, từ đó làm giảm đáng kể hiệu suất tổng thể của hệ thống.

- Giải pháp tối ưu: Bạn nên điều chỉnh độ phân giải đầu vào sao cho khớp với độ phân giải mà mô hình đã được huấn luyện.Hầu hết các mô hình phát hiện vật thể hiện nay, bao gồm các biến thể của YOLO hay RF-DETR, thường được huấn luyện trên kích thước ảnh xấp xỉ 640×640.

Việc truyền tải toàn bộ khung hình 4K chỉ để thu nhỏ chúng lại là một sự lãng phí không đáng có. Hành động này khiến hệ thống phải “gồng mình” xử lý những dữ liệu điểm ảnh không hề giúp cải thiện độ chính xác, mà ngược lại còn làm chậm tốc độ phản hồi của toàn bộ dự án.

Lựa chọn kiến trúc mô hình phù hợp (Model Architecture)

Việc lựa chọn mô hình là một trong những yếu tố quyết định hàng đầu ảnh hưởng đến hiệu suất hệ thống. Thực tế, mọi kiến trúc mô hình đều là sự đánh đổi giữa độ chính xác (Accuracy) và tốc độ xử lý (Speed).

Hầu hết các dòng mô hình hiện nay đều cung cấp dải kích thước đa dạng từ Nano đến Large để đáp ứng các yêu cầu khác nhau về tài nguyên:

- Mô hình nhỏ (như RF-DETR Nano): Mang lại tốc độ xử lý cực nhanh nhưng độ chính xác có thể giảm nhẹ.

- Mô hình lớn (như RF-DETR Large): Giúp cải thiện độ chính xác tối đa nhưng lại làm giảm số khung hình trên giây (FPS).

Chiến lược thực tế: Bạn nên bắt đầu với các phiên bản Nano hoặc Small (ví dụ: YOLO26 hoặc RF-DETR Nano). Chỉ khi độ chính xác không đạt yêu cầu, chúng ta mới nâng cấp lên kích thước lớn hơn. Nhờ đó, hệ thống sẽ tránh được các tính toán dư thừa và duy trì được hiệu suất thời gian thực (Real-time).

Tăng tốc phần cứng (Hardware Acceleration)

Thực tế cho thấy, chỉ tối ưu hóa phần mềm là chưa đủ, bởi lẽ phần cứng mới là yếu tố cuối cùng quyết định tốc độ vận hành của hệ thống. Trong lĩnh vực Thị giác máy tính, GPU chính là giải pháp tăng tốc phần cứng phổ biến và hiệu quả nhất hiện nay.

Mặc dù CPU có thể xử lý các tác vụ cơ bản, nhưng nó sẽ nhanh chóng trở thành “nút thắt cổ chai” (bottleneck) khi độ phức tạp của mô hình hoặc lưu lượng dữ liệu tăng lên.

- Cụ thể là: Việc chạy suy luận (Inference) trên CPU chỉ khả thi với các mô hình đơn giản hoặc ứng dụng có yêu cầu xử lý thấp.

- Tuy nhiên, để đạt được hiệu suất thời gian thực (Real-time), việc trang bị một GPU mạnh mẽ gần như là yêu cầu bắt buộc.

Tiêu chuẩn vàng của ngành: Các dòng NVIDIA GPU với nhân CUDA hiện là tiêu chuẩn hàng đầu cho việc chạy suy luận. Lý do là bởi kiến trúc song song của GPU, với hàng nghìn nhân xử lý các phép toán ma trận cùng lúc, hoàn toàn tương thích và tối ưu cho các tính toán mạng thần kinh (Neural network).

- Minh chứng thực tế: Hãy thử so sánh, một mô hình YOLOv8-Nano có thể chỉ đạt mức 5-10 FPS trên CPU của một chiếc laptop hiện đại. Thế nhưng, cũng chính mô hình đó khi chạy trên NVIDIA T4 GPU có thể đạt tốc độ hơn 60 FPS.

- Kết luận: Sự khác biệt này không chỉ dừng lại ở việc cải thiện thông số, mà nó là ranh giới giữa một hệ thống “thiếu thực tế” và một hệ thống sẵn sàng vận hành.

Lưu ý: Trong trường hợp bạn không có sẵn phần cứng GPU tại chỗ hoặc cần một hạ tầng có khả năng mở rộng linh hoạt, các tùy chọn từ Roboflow Cloud sẽ là một giải pháp thay thế cực kỳ đáng tin cậy.

>> Xem thêm:

- TOP 20 plugin tăng tốc website WordPress tốt nhất, nên dùng hiện nay

- 10+ cách tăng tốc website WordPress vượt trội, mới nhất

Định lượng và Biên dịch mô hình (Model Quantization & Compilation)

Trước khi đưa vào vận hành thực tế, việc tối ưu hóa mô hình thông qua Định lượng (Quantization) và Biên dịch (Compilation) là bước đi then chốt. Quá trình này giúp mô hình trở nên nhỏ gọn hơn, tốc độ xử lý nhanh hơn và tiết kiệm điện năng hơn, từ đó đảm bảo hiệu suất tối ưu trên các thiết bị đầu cuối (Edge) hoặc các ứng dụng thời gian thực.

Định lượng mô hình (Model Quantization)

Hiểu đơn giản, định lượng là quá trình giảm độ chính xác của các trọng số và kích hoạt trong mô hình, thường là từ số thực phẩy động 32-bit (FP32) xuống còn 16-bit (FP16) hoặc số nguyên 8-bit (INT8).

Lợi ích:

- Thu gọn kích thước: Giảm đáng kể dung lượng lưu trữ và bộ nhớ tiêu thụ.

- Tăng tốc suy luận: Các phép toán số nguyên luôn được xử lý nhanh hơn so với số thực phẩy động.

- Tiết kiệm năng lượng: Cực kỳ hữu ích cho các thiết bị di động, hệ thống nhúng hoặc các thiết bị chạy bằng pin.

Các phương pháp phổ biến:

- Định lượng sau huấn luyện: Áp dụng trực tiếp sau khi mô hình đã hoàn tất việc huấn luyện.

- Huấn luyện nhận biết định lượng: Mô hình được huấn luyện trong điều kiện đã tính toán đến độ chính xác thấp, giúp duy trì chất lượng nhận diện tốt hơn.

Hỗ trợ từ Roboflow: Nền tảng này cung cấp các công cụ tự động để định lượng mô hình, giúp chúng sẵn sàng triển khai trên CPU, GPU và các thiết bị chuyên dụng như NVIDIA Jetson hay Luxonis OAK.

Biên dịch mô hình (Model Compilation)

Biên dịch là quá trình chuyển đổi một mô hình đã huấn luyện sang một định dạng tối ưu hóa riêng cho phần cứng. Nói cách khác, đây là bước “may đo” mô hình để nó chạy mượt mà nhất trên từng loại thiết bị cụ thể.

Quá trình này bao gồm:

- Chuyển đổi mô hình sang các định dạng tiêu chuẩn như ONNX, TensorRT, CoreML hoặc TFLite.

- Áp dụng các kỹ thuật tối ưu hóa chuyên sâu như hợp nhất các lớp (Layer fusion), đơn giản hóa toán tử và tối ưu bộ nhớ.

Lợi ích:

- Giảm độ trễ: Tốc độ thực thi trên thiết bị có thể tăng gấp 2 đến 5 lần nhờ sử dụng TensorRT hoặc ONNX.

- Tận dụng tối đa phần cứng: Khai thác hiệu quả sức mạnh của các nhân GPU, TPU hoặc NPU.

- Sẵn sàng triển khai: Tạo ra một tệp tối ưu duy nhất, gọn nhẹ cho phần cứng mục tiêu.

Ví dụ: Một mô hình YOLOv8 có thể được định lượng về dạng INT8 và biên dịch sang TensorRT để chạy trên thiết bị Jetson. Sự kết hợp này cho phép hệ thống thực hiện suy luận thời gian thực với chỉ số FPS cực cao.

Tối ưu hóa luồng xử lý phần mềm

- Vấn đề cốt lõi: Ngay cả khi sở hữu GPU mạnh nhất và mô hình hiệu quả nhất, chỉ số FPS (số khung hình trên giây) vẫn có thể sụt giảm nếu “đường ống” phần mềm của bạn trở thành nút thắt cổ chai.

- Giải pháp: Để khắc phục điều này, Roboflow cung cấp các công cụ mạnh mẽ giúp tối đa hóa lưu lượng xử lý (throughput) và duy trì hiệu suất vận hành mượt mà, cụ thể như:

Xử lý song song (Parallel Processing)

Công nghệ xử lý song song của Roboflow được thiết kế để khai thác tối đa sức mạnh phần cứng bằng cách vận hành nhiều mô hình cùng lúc và quản lý từng bước suy luận một cách thông minh.

Cơ chế hoạt động:

- Vận hành đồng thời: Nhờ tính năng Roboflow Inference Parallel, hệ thống có thể xử lý nhiều yêu cầu cùng một lúc theo cơ chế bất đồng bộ (Asynchronous).

- Tối ưu hóa luồng: Các công đoạn như tiền xử lý, gom lô (Batching), suy luận và hậu xử lý được chia nhỏ ra các luồng (Thread) riêng biệt. Chính nhờ vậy, chỉ số FPS của máy chủ được đẩy lên mức tối đa.

- Quản lý bộ nhớ thông minh: Các yêu cầu gửi đến cùng một mô hình sẽ tự động được nhóm lại để xử lý tập trung, trong khi kết quả trả về vẫn đảm bảo tính độc lập. Đặc biệt, dữ liệu hình ảnh được chia sẻ ngay trong bộ nhớ để tăng tốc độ truy xuất.

- Hiệu quả thực tế: Các bài kiểm tra hiệu năng (Benchmarks) cho thấy phương pháp này giúp tăng tốc độ xử lý lên đến 76% và đạt chỉ số FPS cao hơn hẳn so với các thiết lập thông thường.

Luồng suy luận cho Video (Inference Pipeline)

Đây là giải pháp giúp bạn xử lý các luồng trực tiếp (Live streams) và tệp video một cách hiệu quả, đảm bảo hiệu suất thời gian thực ngay cả khi phải xử lý nhiều nguồn dữ liệu cùng lúc.

Đặc điểm nổi bật:

- Hỗ trợ đa nguồn: Giao diện bất đồng bộ này được tối ưu cho việc truyền phát video thực tế, hỗ trợ từ Webcam, luồng RTSP cho đến các tệp video có sẵn.

- Cơ chế bắt hình thông minh: Các khung hình (Frames) được thu thập, đưa vào bộ đệm và xử lý tách biệt. Đáng chú ý là, hệ thống sẽ tự động bỏ qua các khung hình cũ để ưu tiên tính thời sự và độ chính xác trong thời gian thực.

- Đảm bảo tính ổn định: Hệ thống luôn tự động điều phối tốc độ xử lý để tránh tình trạng quá tải, giúp vận hành ổn định trong thời gian dài.

Suy luận theo từng đợt (Batched Inference)

Suy luận theo từng đợt của Roboflow mang đến một phương thức đơn giản nhưng cực kỳ mạnh mẽ để xử lý khối lượng lớn hình ảnh hoặc video, nơi mọi khâu từ hạ tầng đến lập lịch đều được tự động hóa hoàn toàn.

Lợi ích mang lại:

- Xử lý khối lượng lớn: Đây là lựa chọn lý tưởng cho các bộ sưu tập ảnh khổng lồ hoặc video lưu trữ lâu ngày. Hệ thống sẽ tự động điều động hạ tầng cần thiết dựa trên quy trình (Workflows) có sẵn.

- Cấu hình linh hoạt: Bạn có thể thiết lập công việc thông qua giao diện web trực quan hoặc qua API. Dù là dự án nhỏ hay khối lượng công việc khổng lồ, đây vẫn là một giải pháp quản lý toàn diện.

- Tiết kiệm nguồn lực: Sự kết hợp giữa giao diện người dùng đơn giản và API mạnh mẽ giúp bạn xây dựng các đường ống dữ liệu (Pipelines) tự động mà không cần tốn công viết mã (No-code).

>> Xem thêm:

- Các mô hình phát hiện đối tượng trên iOS tốt nhất hiện nay

- Object Detection Models: Các mô hình phát hiện đối tượng tốt nhất

- Các mô hình ngôn ngữ thị giác chạy cục bộ tốt nhất

4. Xây dựng lớp Logic với Roboflow Workflows

Hầu hết các hệ thống Computer Vision đều cần một “lớp logic” để chuyển đổi kết quả đầu ra của mô hình thành các hành động thực tế, đồng thời quản lý mọi bước tiền xử lý cần thiết trước khi dữ liệu đi vào mô hình.

- Vai trò của điều phối (Orchestration): Đây chính là nơi việc điều phối quy trình trở nên thiết yếu. Nó kết nối các mô hình, các quyết định và hành động thành một “đường ống” (pipeline) có cấu trúc, giúp hệ thống vận hành tin cậy mà không cần sự can thiệp thủ công liên tục.

- Xây dựng trực quan: Với Roboflow Workflows, lớp logic này có thể được xây dựng một cách trực quan. Thay vì phải viết những đoạn mã điều phối phức tạp, bạn có thể tạo ra các quy trình bằng cách xâu chuỗi các khối mô-đun thông qua giao diện kéo-thả cực kỳ đơn giản.

- Tính linh hoạt: Mỗi khối đại diện cho một bước cụ thể trong quá trình ra quyết định, giúp hệ thống trở nên dễ xây dựng, dễ hiểu và dễ dàng mở rộng quy mô hơn bao giờ hết.

Các danh mục khối công việc (Workflow Blocks)

Các thành phần dựng sẵn trong Roboflow Workflows được chia thành các nhóm chức năng chính sau:

- Models (Mô hình): Chạy các mô hình đã tinh chỉnh hoặc mô hình nền tảng như SAM 3, YOLO26-Pose, Depth Anything 3.

- Visualizations (Trực quan hóa): Hiển thị kết quả của mô hình bằng các kỹ thuật như vẽ điểm chốt (Keypoint), đa giác (Polygon) hoặc cắt vùng ảnh (Crop).

- Logic and Branching (Logic & Phân nhánh): Kiểm soát luồng công việc với các điều kiện như “Tiếp tục nếu” (Continue If) hoặc “Bộ lọc phát hiện” (Detections Filter).

- Data Storage (Lưu trữ dữ liệu): Lưu dữ liệu vào tập dữ liệu Roboflow hoặc cơ sở dữ liệu bên ngoài.

- Notifications (Thông báo): Gửi cảnh báo tức thì qua tin nhắn SMS hoặc Email.

- Video Processing (Xử lý Video): Phân tích nội dung video với các thuật toán theo dõi (tracking), phân tích thời gian trong vùng (time-in-zone) hoặc kiểm tra cắt ngang vạch (line-crossing).

- Transformations (Biến đổi): Xử lý dữ liệu hình ảnh và dự đoán như dịch chuyển vùng nhận diện (Detection Offset) hoặc hợp nhất các kết quả (Detections Merge).

- Classical Computer Vision (Thị giác máy tính truyền thống): Thực hiện các tác vụ kinh điển như phát hiện cạnh, khớp mẫu (template matching) hoặc đo kích thước.

- Enterprise (Doanh nghiệp): Kết nối Roboflow với hệ thống doanh nghiệp qua các giao thức công nghiệp như MQTT, OPC UA, hoặc Modbus TCP.

- Advanced & Custom (Nâng cao & Tùy chỉnh): Các khối phân tích ĐẠT/KHÔNG ĐẠT (PASS/FAIL), lưu trữ đệm dữ liệu (caching) hoặc tự tạo các khối chức năng riêng bằng Python.

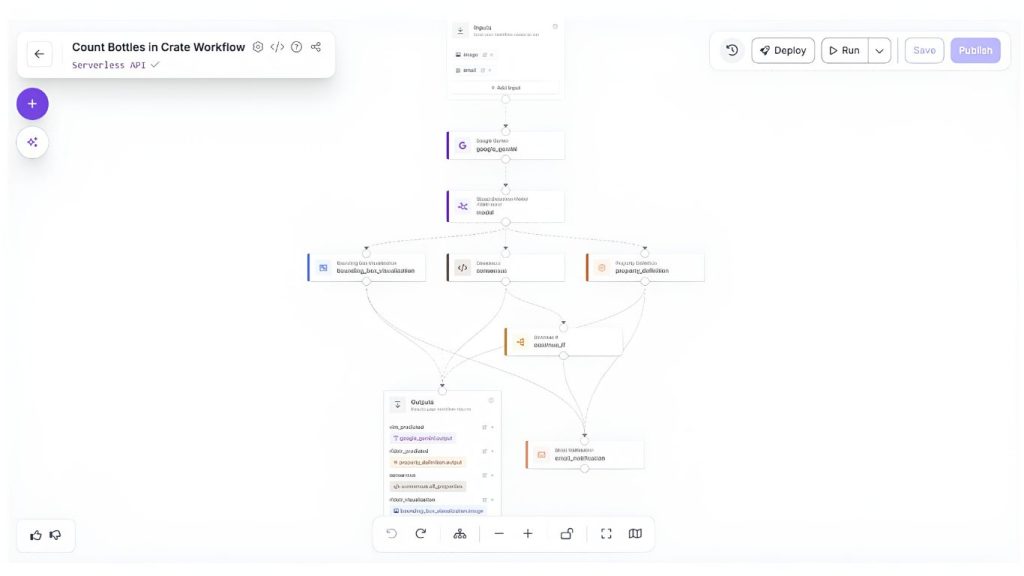

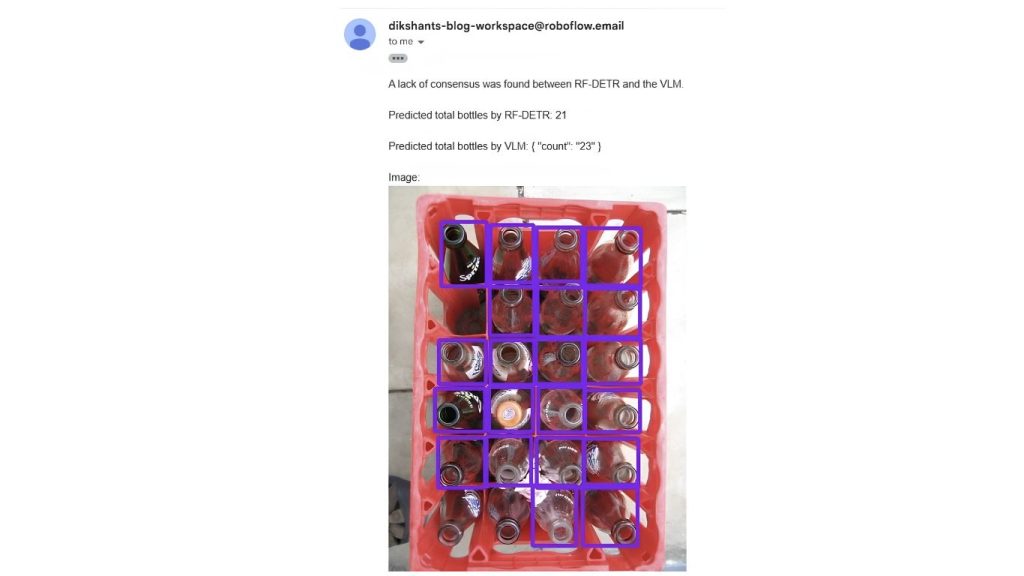

Ví dụ minh họa: Hệ thống kiểm kê tự động

Hãy tưởng tượng một quy trình kiểm tra số lượng chai trong thùng. Đầu tiên, hệ thống dùng một mô hình ngôn ngữ thị giác (VLM) để ước tính số lượng, sau đó chạy tiếp mô hình RF-DETR để đếm lại lần nữa.

Ra quyết định: Kết quả từ hai mô hình sẽ được so sánh để tạo ra sự thống nhất (consensus).

- Nếu khớp: Kết quả được chấp nhận và ghi nhận.

- Nếu sai lệch: Hình ảnh sẽ bị gắn cờ để kiểm tra lại, đồng thời một email hoặc thông báo Slack sẽ tự động được gửi đi.

Kết luận: Bằng cách kết hợp các khối này, bạn có thể biến những dự đoán thô từ mô hình thành một hệ thống tự động hoàn chỉnh, có khả năng ra quyết định và hành động ngay trong thời gian thực.

Dưới đây là nội dung email thông báo được gửi đi khi kết quả từ các mô hình không đạt được sự thống nhất (Consensus)

>> Xem thêm:

- Khả năng thị giác của Chat GPT-5 và Cách Prompt hiệu quả

- AI Data Labeling: Hướng dẫn gán nhãn dữ Liệu AI

- Predictive AI là gì? Cách AI dự đoán hành vi và xu hướng tương lai

Toàn bộ quy trình này được vận hành chỉ trong một luồng công việc duy nhất mà bạn có thể thiết lập chỉ trong vài phút.

Nếu không có Roboflow Workflows, việc xây dựng một hệ thống tương đương thường sẽ tiêu tốn của đội ngũ kỹ sư khoảng một tuần làm việc.

Bên cạnh đó, bạn sẽ phải đối mặt với một lượng lớn mã nguồn lặp lại (Boilerplate code) vô cùng phức tạp và tốn thời gian để duy trì.

5. Quản trị vận hành (MLOps)

Để một hệ thống Computer Vision vận hành mượt mà trong thực tế, việc thiết lập các quy trình giám sát chặt chẽ, cải tiến liên tục và quản lý quy mô lớn là vô cùng cấp thiết.

Những quy trình này bao gồm việc theo dõi sự sụt giảm hiệu suất mô hình (Model Drift), áp dụng học tập chủ động (Active Learning) và khả năng triển khai từ xa trên nhiều thiết bị khác nhau.

Giám sát sự sụt giảm hiệu suất (Monitoring Model Drift)

Việc phát hiện Model Drift đòi hỏi phải giám sát liên tục các dự đoán, mức độ tin cậy và tỷ lệ lỗi. Chính vì vậy, khi hiệu suất mô hình giảm sút, đội ngũ kỹ thuật cần xác định ngay nguyên nhân đến từ sự thay đổi của dữ liệu đầu vào, cập nhật phần cứng hay do biến động của môi trường vận hành.

Sẽ rất rủi ro nếu thiếu một hệ thống giám sát đúng nghĩa, sự xuống cấp của mô hình có thể bị bỏ qua cho đến khi nó bắt đầu gây ảnh hưởng trực tiếp đến hoạt động kinh doanh.

- Để quy trình này trở nên đơn giản và hiệu quả hơn, Roboflow Model Monitoring cung cấp một bảng điều khiển (Dashboard) trực quan, mang lại cái nhìn sâu sắc về hiệu suất thực tế của các mô hình đã triển khai. Nhờ đó, bạn có thể theo dõi hiệu suất tổng thể theo thời gian hoặc kiểm tra từng yêu cầu suy luận cụ thể để đánh giá các trường hợp biên (Edge cases).

Các tính năng nổi bật của Roboflow Model Monitoring:

- Quản lý thiết bị: Kiểm tra trạng thái trực tuyến (Online/Offline) của từng thiết bị trong hệ thống.

- Theo dõi lưu lượng: Thống kê số lượng lượt suy luận từ mỗi thiết bị cụ thể.

- Đánh giá chất lượng: Giám sát độ tin cậy (Confidence) trung bình và trung vị của các dự đoán.

- Đo lường tốc độ: Xác định thời gian suy luận trung bình để đảm bảo tính thời gian thực.

- Kiểm tra chi tiết: Xem xét từng kết quả dự đoán, bao gồm cả vùng nhận diện và hình ảnh thực tế được sử dụng trong yêu cầu suy luận.

- Tùy biến dữ liệu: Truy cập các siêu dữ liệu (Metadata) tùy chỉnh ngay trên bảng điều khiển.

- Cảnh báo tức thì: Nhận thông báo ngay khi có các sự kiện quan trọng hoặc phát hiện dấu hiệu bất thường.

Học tập chủ động (Active Learning)

Active Learning là phương pháp duy trì hiệu suất cao cho mô hình bằng cách tự động gắn cờ các dự đoán chưa chắc chắn để con người xem xét. Sau đó, những dữ liệu mới được dán nhãn này sẽ được đưa ngược lại vào bộ dữ liệu huấn luyện để cải tiến mô hình một cách liên tục.

Theo thời gian, quy trình này giúp tạo ra các mô hình ngày càng chính xác và mạnh mẽ hơn. Vòng đời của nó diễn ra theo chu kỳ khép kín: Triển khai → Thu thập dữ liệu → Huấn luyện lại → Tái triển khai.

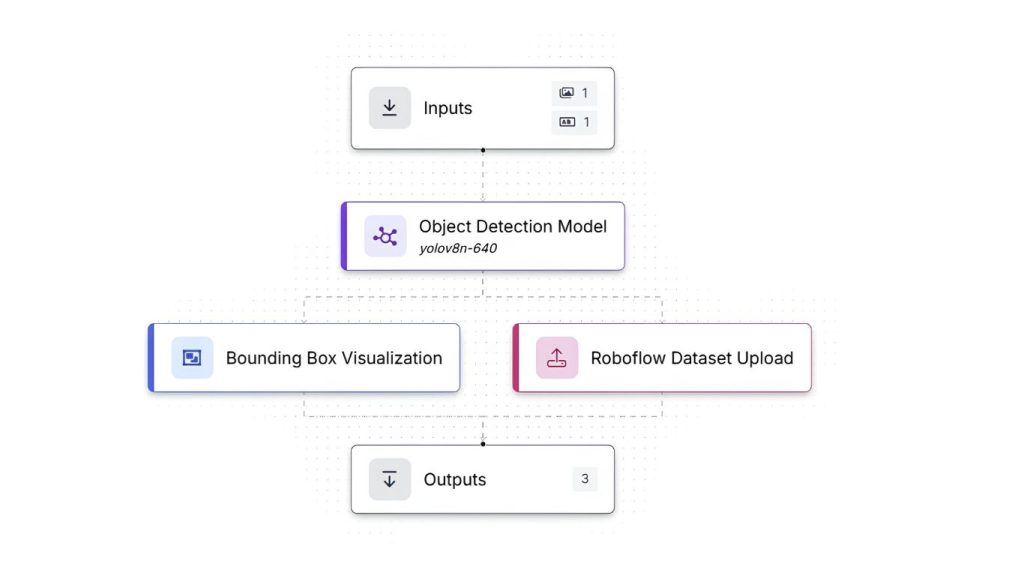

Với Roboflow Workflows, khối chức năng Dataset Upload Block có thể xử lý việc này cực kỳ hiệu quả, chẳng hạn như bạn có thể cấu hình để chỉ tải lên khoảng 5% hình ảnh tiêu biểu từ dây chuyền sản xuất nhằm tiết kiệm tài nguyên mà vẫn đảm bảo chất lượng dữ liệu.

Ví dụ minh họa quy trình Active Learning:

- Vận hành tại thiết bị (Edge): Quy trình được thực hiện trực tiếp ngay trên các thiết bị đầu cuối.

- Đồng bộ hóa Đám mây (Cloud): Cả kết quả dự đoán và hình ảnh gốc sẽ được gửi lên đám mây, sau đó lưu trữ như một phần của bộ dữ liệu (Dataset) phục vụ cho việc huấn luyện mô hình trong tương lai.

- Lợi ích: Sự phối hợp này đảm bảo hệ thống không chỉ hoạt động ổn định ở hiện tại mà còn “thông minh” hơn sau mỗi lần vận hành.

Video dưới đây minh họa cùng một quy trình đã được kiểm thử trên ứng dụng web của Roboflow với hình ảnh của một chiếc container. Tại đây, cả hình ảnh gốc lẫn kết quả dự đoán được tạo ra đều được quy trình này gửi lên đám mây (Roboflow Universe). Những dữ liệu này sau đó có thể được tận dụng để huấn luyện và nâng cấp các phiên bản mới cho mô hình.

>> Xem thêm:

- Phrase Grounding là gì? Mô hình và cách hoạt động

- Top 5 thư viện Python cho thị giác máy tính – So sánh sự khác nhau

- Xây dựng ứng dụng phát hiện đối tượng bằng Python chỉ trong vài phút với Roboflow

Triển khai từ xa ở quy mô lớn

Triển khai từ xa ở quy mô lớn là quá trình thiết lập và vận hành các mô hình Computer Vision trên hàng loạt thiết bị hoặc địa điểm khác nhau mà không cần phải có mặt trực tiếp tại từng vị trí.

Cơ chế vận hành: Thay vì cài đặt thủ công trên từng máy đơn lẻ, hệ thống có khả năng tự động đẩy các bản cập nhật, quản lý và giám sát mô hình từ xa trên nhiều máy chủ, thiết bị đầu cuối (Edge) hoặc hệ thống camera cùng một lúc.

Các tính năng hỗ trợ triển khai từ xa từ Roboflow:

- Cập nhật và quản lý từ xa:

- Thông qua Roboflow Deployment Manager và Inference Server, các mô hình có thể được cập nhật hoàn toàn từ xa.

- Đáng chú ý là, khi một phiên bản mới được phát hành, các thiết bị đầu cuối đang kết nối sẽ tự động nhận bản cập nhật thông qua cơ chế truy vấn (polling) hoặc cấu hình đẩy.

- Hệ thống bảng điều khiển (Dashboard) giúp theo dõi hiệu suất, tỷ lệ lỗi và nhật ký suy luận (logs), cho phép bạn kiểm soát tình trạng sụt giảm hiệu suất (drift) hoặc lỗi trên toàn bộ hệ thống triển khai.

- Điểm cuối API có khả năng mở rộng:

- Roboflow cung cấp các điểm cuối (endpoints) cho mô hình và quy trình làm việc, giúp nhiều ứng dụng hoặc thiết bị có thể truy cập cùng một mô hình đồng thời.

- Giải pháp này loại bỏ việc phải cài đặt mô hình thủ công trên từng thiết bị. Việc truy cập trực tiếp qua API giúp cập nhật mô hình dễ dàng mà không cần phải phát hành lại các phiên bản ứng dụng mới.

- Quản lý phiên bản và Hoàn tác:

- Bạn có thể triển khai song song nhiều phiên bản của một mô hình và chuyển đổi linh hoạt giữa chúng mà không làm gián đoạn vận hành.

- Đây là tính năng sống còn đối với các hệ thống quy mô lớn, nơi một bản cập nhật lỗi có thể gây ảnh hưởng dây chuyền đến hàng loạt thiết bị nếu không có phương án hoàn tác kịp thời.

Kết luận: Việc triển khai là một hành trình, không phải là đích đến

Bạn đã biết cách triển khai Computer Vision, nhưng đây không phải là một bước thực hiện duy nhất; đó là một quy trình cải tiến không ngừng. Một mô hình có thể tiến xa từ giai đoạn phát triển đến thực tế, tuy nhiên, hiệu quả thực sự của nó phụ thuộc hoàn toàn vào việc giám sát và tinh chỉnh liên tục.

Trong môi trường sản xuất, các yếu tố như dữ liệu đầu vào biến động, điều kiện môi trường thay đổi và yêu cầu nghiệp vụ mới sẽ khiến ngay cả những mô hình xuất sắc nhất cũng dần mất đi độ chính xác vốn có.

Chính vì vậy, các hệ thống thành công luôn tuân theo một vòng lặp khép kín: Triển khai mô hình vào môi trường thực tế → Giám sát hiệu suất và hành vi → Tái huấn luyện và tối ưu hóa dựa trên dữ liệu mới thu thập được.

Nguồn tham khảo: How to Deploy Computer Vision

TOT là đơn vị tiên phong trong hành trình chuyển đổi số. Chúng tôi mang đến giải pháp thiết kế website, mobile app và viết phần mềm theo yêu cầu với dịch vụ linh hoạt, tối ưu theo đúng nhu cầu của doanh nghiệp.

Lấy cảm hứng từ triết lý “Công nghệ vì con người”, TOT giúp doanh nghiệp vận hành hiệu quả hơn, nâng tầm trải nghiệm khách hàng và tạo dấu ấn bền vững cho thương hiệu.

Thông tin liên hệ TopOnTech (TOT):

📞 Hotline/WhatsApp/Zalo: 0906 712 137

✉️ Email: long.bui@toponseek.com

🏢 Địa chỉ:31 Đường Hoàng Diệu, Phường Xóm Chiếu, TP. Hồ Chí Minh, Việt Nam